Inteligência Artificial Explicável(XAI, sigla em inglês) é um assunto que tem sido frequentemente debatido nos últimos anos e é um assunto de contradições. Antes de discutirmos a confiabilidade da Inteligência Artificial (IA), se a IA está tentando modelar nosso pensamento e tomada de decisão, devemos ser capazes de explicar como realmente tomamos nossas decisões! Não é?

Uma breve explicação

IA explicável, IA interpretável ou IA transparente referem-se a técnicas de inteligência artificial (IA) que podem ser confiáveis e facilmente entendidas pelos seres humanos. Contrasta com o conceito da ” caixa preta ” no aprendizado de máquina, onde até mesmo os projetistas não conseguem explicar por que a IA chegou a uma decisão específica.

Existe uma transformação de aprendizado de máquina que vem ocorrendo às vezes mais rápido e às vezes mais lenta desde os anos 1950. No passado recente, a área mais estudada e marcante é a aprendizagem de máquina, que visa modelar o sistema de decisão, o comportamento e as reações.

Os resultados bem sucedidos obtidos no campo da aprendizagem de máquina levaram a um rápido aumento na implementação da IA.

Especialmente após a década de 1990, o conceito de aprendizagem profunda é baseado no passado, mas as redes neurais recursivas, as redes neurais convolucionais, o aprendizado por reforço e as redes contenciosas são notavelmente bem-sucedidas. Embora os resultados bem-sucedidos sejam obtidos, é difícil explicar as decisões e ações desses sistemas para usuários humanos.

Os modelos de aprendizagem profunda projetados com centenas de milhões de redes neurais artificiais em camadas não são infalíveis. Eles podem perder sua credibilidade rapidamente, especialmente quando são simplesmente enganados, como no caso de um ataque de um pixel! Então, torna-se inevitável fazer a pergunta de quão bem sucedido ou mal sucedido!

A complexidade deste tipo de aplicações avançadas aumenta com os sucessos e a capacidade de explicação torna-se difícil. Mesmo em algumas conferências, há apenas sessões em que esse tópico é discutido.

As razões para a nova máquina/sistemas de aprendizagem profunda

O objetivo é explicar as razões para os novos sistemas de aprendizado de máquina/profundidade, determinar seus pontos fortes e fracos e entender como se comportar no futuro. A estratégia para alcançar este objetivo é desenvolver técnicas de aprendizado artificial novas ou modificadas que produzirão modelos mais definíveis.

Esses modelos destinam-se a ser combinados com técnicas interativas de interface homem-computador, que podem converter modelos em diálogos de explicação compreensíveis e úteis para o usuário final.

Com três expectativas básicas, deseja-se abordar o sistema:

▪. Explique o propósito por trás de como as partes que projetam e usam o sistema são afetadas.

▪ Explique como as origens de dados e os resultados são usados.

▪ Explique como as entradas de um modelo de AI levam a saídas.

“O XAI é um dos poucos programas atuais da DARPA que devem permitir – os sistemas de IA de terceira onda – onde as máquinas entendem o contexto e o ambiente em que operam e, com o tempo, constroem modelos explicativos subjacentes que permitem caracterizar fenômenos do mundo real. .

Se partirmos da prática médica, depois de examinar os dados do paciente, o médico deve entender e explicar ao paciente que ele propôs ao paciente em questão o risco de um ataque cardíaco com base na recomendação do sistema de apoio à decisão.

Nesta fase, em primeiro lugar, quais dados são avaliados é outro critério importante. Também é importante identificar quais dados são necessários e o que precisa ser feito para uma avaliação adequada.

A psicologia da explicação

Vejamos o ponto em que nos recusamos a usar tecnologia de aprendizado artificial porque não podemos explicar como a inteligência artificial dá sua decisão. Por outro lado, muitas pessoas não conseguem realmente explicar como tomaram a decisão!

Vamos imaginar como uma pessoa chegou a uma decisão no nível do modelo: Quando abordamos nossa estrutura biológica nos níveis físico e químico, estamos falando de sinais elétricos de uma célula cerebral para outra. Se não ficar satisfeito com esta explicação, diga-me como decidiu encomendar um café!

Quando um de seus amigos pediu um café gelado, o outro pediu café quente e o outro pediu uma xícara de chá. Por que eles escolhem café gelado e café quente? Alguém pode explicar química e sinapses no cérebro? Você pode explicar? Você quer tal explicação? Você sabe o que é isso? Um humano está começando a inventar uma história sobre como ele decide.

Basta olhar para os dados de entrada e saída e contar uma história divertida! De fato, há uma abordagem semelhante para questões analíticas e importantes. Interpretações, transparência e clareza são analíticas, e as análises sem um teste são como um bilhete de trem de ida que causa uma sensação de segurança.

Em perfeitas condições;

- Um sistema que produz o melhor desempenho,

- Você quer a melhor explicação.

Mas a vida real nos força a escolher.

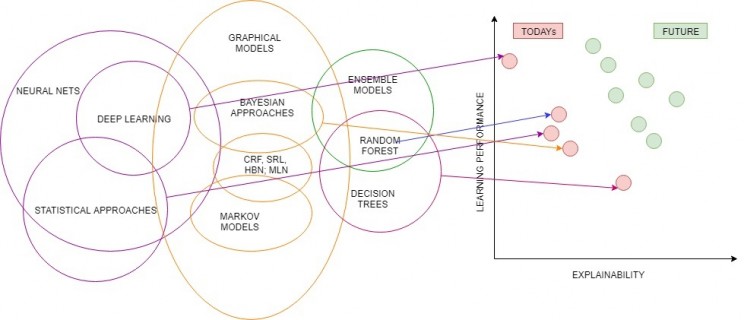

Desempenho vs Explicabilidade

Interpretação: Você entende, mas não funciona bem!

Performance: Você não entende, mas funciona bem!

Acadêmicos, pesquisadores e empresas de tecnologia geralmente não dão muita atenção na medida em que darão mais importância ao desempenho. No entanto, o cenário com as pessoas e instituições envolvidas no setor é um pouco diferente. Eles querem confiar e estão esperando por uma explicação.

As abordagens de IA diferem para bancos, seguradoras, prestadores de serviços de saúde e outros setores diferentes. Isso ocorre porque os modelos para esses setores trazem diferentes regulamentações legais e requisitos éticos. Neste caso, chegamos ao mesmo ponto novamente. Se você quiser que seu sistema seja explicado na seguinte condição, você terá que substituí-lo pelo mais simples que não é muito forte, por enquanto!

Pesquisas sobre este assunto são principalmente da DARPA, Google, DeepMind e assim por diante. Enquanto as instituições continuam a ser intensivamente realizadas, entende-se a partir dos relatórios; Não importa qual setor e quem é usado pelos sistemas de inteligência artificial, existe uma relação entre clareza e precisão que uma troca é inevitável e parece continuar por um tempo.

Afinal, a IA não deve ser transformada em um poder divino que seremos levados a buscar sem estabelecer uma relação de causa e efeito. Por outro lado, não devemos ignorar o insight que nos será fornecido.

Basicamente, devemos pensar em criar modelos flexíveis e interpretáveis que possam trabalhar juntos em harmonia com os especialistas que têm conhecimento no nível técnico e acadêmico e as opiniões de diferentes setores e disciplinas.

Achou útil essa informação? Compartilhe com seus amigos! xD

Deixe-nos a sua opinião aqui nos comentários.