Os bioengenheiros da UCLA projetaram um dispositivo semelhante a uma luva que pode traduzir a linguagem de sinais americana para a fala em inglês em tempo real através de um aplicativo para smartphone. Sua pesquisa é publicada na revista Nature Electronics.

“Nossa esperança é que isso abra um caminho fácil para as pessoas que usam a linguagem de sinais se comunicarem diretamente com os que não assinam, sem precisar de outra pessoa para traduzir para eles”, disse Jun Chen, professor assistente de bioengenharia da Escola de Engenharia Samueli da UCLA e pesquisador principal da pesquisa. “Além disso, esperamos que isso ajude mais pessoas a aprender a linguagem de sinais”.

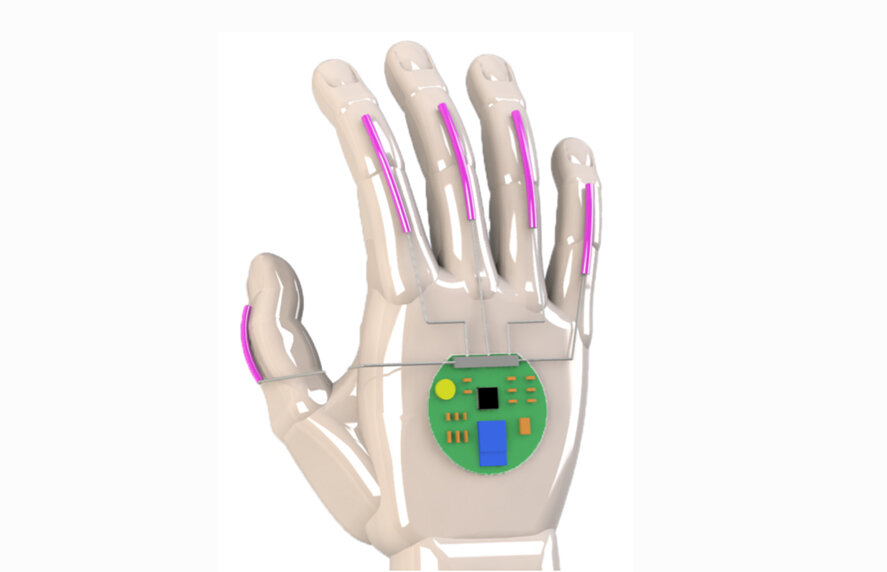

O sistema inclui um par de luvas com sensores finos e elásticos que percorrem o comprimento de cada um dos cinco dedos. Esses sensores, feitos de fios condutores elétricos, captam movimentos das mãos e posicionamentos dos dedos que representam letras, números, palavras e frases individuais.

O dispositivo transforma os movimentos dos dedos em sinais elétricos, que são enviados para uma placa de circuito do tamanho de uma moeda de um dólar usada no pulso. A placa transmite esses sinais sem fio para um smartphone que os traduz em palavras faladas a uma taxa de cerca de uma palavra por segundo.

Os pesquisadores também adicionaram sensores adesivos ao rosto dos testadores – entre as sobrancelhas e um lado da boca – para capturar expressões faciais que fazem parte da linguagem de sinais americana.

Os sistemas vestíveis anteriores que ofereciam tradução da American Sign Language eram limitados por designs de dispositivos volumosos e pesados ou eram desconfortáveis de usar, disse Chen.

O dispositivo desenvolvido pela equipe da UCLA é fabricado a partir de polímeros elásticos, leves e baratos, mas de longa duração. Os sensores eletrônicos também são muito flexíveis e baratos.

Ao testar o dispositivo, os pesquisadores trabalharam com quatro pessoas surdas e usam a linguagem de sinais americana. Os usuários repetiram cada gesto com a mão 15 vezes. Um algoritmo de aprendizado de máquina personalizado transformou esses gestos em letras, números e palavras que eles representavam. O sistema reconheceu 660 sinais, incluindo cada letra do alfabeto e os números de 0 a 9.

A UCLA solicitou uma patente sobre a tecnologia. Um modelo comercial baseado nessa tecnologia exigiria vocabulário adicional e um tempo de tradução ainda mais rápido, disse Chen.

Achou útil essa informação? Compartilhe com seus amigos! xD

Deixe-nos a sua opinião aqui nos comentários.

![Luva de tecnologia vestível traduz a linguagem de sinais em fala em tempo real [vídeo]](https://cdnsjengenhariae.nuneshost.com/wp-content/uploads/2020/06/wearabletech.jpg)